AI去衣裸体网站背后:科技与伦理的警钟响起

数字化浪潮下,人工智能技术正在重塑我们的生活方式。但在追求效率与便利的同时,一些技术滥用的边界问题正在显现。近期曝光的AI图像处理应用案例,引发了社会各界对科技的深度思考。当算法突破隐私保护红线时,我们不得不审视技术进步与社会价值观之间的平衡。

一、AI技术的双刃剑效应

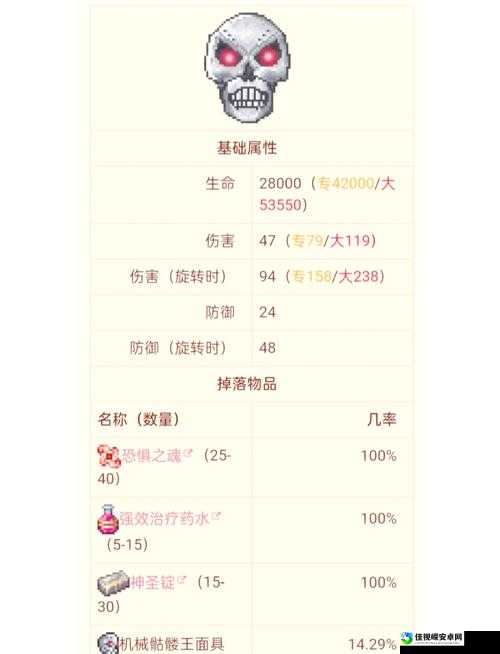

深度伪造技术通过AI模型学习人体特征,能在未经本人同意的情况下生成图像内容。这类技术原本用于影视特效、医学影像分析等领域,却被恶意应用于侵犯个人权益。值得注意的是,掌握这项技术的并非全是犯罪分子,更有正规技术服务商为商业利益提供技术支持。

技术提供方常常以"中立工具论"推卸责任,这种认知偏差正在加剧社会信任危机。某知名AI平台曾因图像处理功能被滥用,导致数千名普通用户遭遇身份冒用事件。技术中立不等于责任豁免,服务提供者必须建立更严格的内容审核机制。

二、数字画像背后的困境

受害者群体正在承受双重伤害。某模特因AI合成图被错误绑定成犯罪片角色,导致个人事业遭受毁灭性打击。这种无形伤害比传统诈骗更具隐蔽性,受害者往往难以取证维权。网络空间并非法外之地,监管部门需要建立更完善的数字内容追溯体系。

社会对这类技术的认知存在严重割裂。一方面惊叹AI绘画的创作效率,另一方面又对深度伪造技术产生本能抗拒。这种矛盾心态源于人们对技术边界缺乏清晰认知,需要通过科普教育建立更理性看待新技术的态度。

三、构建负责任的技术生态

技术开发者需要建立更完善的技术使用规范。某AI训练平台已采用"AI指纹"技术,为图像内容打上可追踪的标识。这种做法既保留技术创新空间,又能有效遏制技术滥用。

用户群体更要强化自我保护意识。面对网络世界的各种图像信息,应该保持审慎态度。有调查发现,超过70%的受害者在遭遇侵权前从未阅读过平台用户协议。

行业组织正在尝试建立多方协作机制。近期国内多家AI企业联合发布数字内容可信度宣言,承诺开发"深伪内容"识别工具。这种多方参与的治理模式,为解决技术滥用问题提供了新思路。

科技发展永远不应该以牺牲人性为代价。当AI图像处理技术突破合理使用边界时,需要政府监管、企业责任、公众意识形成合力。这不是要否定技术价值,而是要在守护人性尊严的基础上,探索更健康的技术进化路径。正如一位科学家所说:"让技术服务于人性,而不是成为新的枷锁。"